Angle

Les fondements des données pour une adoption responsable de l'IA

- Information governance

- 3 mins

À mesure que l'IA s'intègre dans les flux de travail des entreprises, les responsables juridiques et de la conformité endossent un nouveau rôle : ils ne se contentent plus de gérer les risques, mais élaborent également une stratégie en matière de données pour définir la structure, les contrôles et les responsabilités nécessaires à une adoption responsable de l'IA, notamment à l'aide d'outils à l'échelle de l'entreprise tels que Copilot pour Microsoft 365.

Cette série explore comment les équipes juridiques et de conformité peuvent mener la charge vers une préparation responsable à l'IA.

Les promesses et les pièges

L'IA offre un nouvel outil puissant pour rationaliser les tâches des travailleurs du savoir, telles que la création de stratégies marketing, les propositions de budgets financiers, l'analyse concurrentielle et la synthèse des dossiers de service à la clientèle. Cependant, les mêmes capacités qui rendent l'IA si attrayante exposent également les données sensibles à un risque de surexposition.

Avant l'adoption généralisée de l'IA, les méthodes de stockage et d'accès aux données différaient d'une entreprise à l'autre, voire d'une fonction à l'autre. Les utilisateurs, et même les dirigeants, avaient souvent une compréhension limitée des informations sensibles accessibles et des personnes qui pouvaient y accéder, comptant sur le manque de sensibilisation d'une grande partie des employés pour assurer la sécurité des documents sensibles. Aujourd'hui, des outils tels que Microsoft Copilot peuvent accéder à toutes les données qu'un utilisateur est autorisé à consulter et les afficher. Cela peut révéler par inadvertance des contenus sensibles (par exemple, des documents de stratégie commerciale, des communications privilégiées ou des informations personnelles identifiables (PII)) qui n'étaient pas destinés à être largement diffusés.

Historiquement, les contrôles d'accès étaient conçus pour les flux de travail manuels. Un utilisateur pouvait avoir accès à des milliers de fichiers, mais sans invite de recherche ni navigation directe, il ne pouvait jamais accéder à la plupart d'entre eux. L'IA change la donne. Elle synthétise et fait remonter des informations provenant de l'ensemble du parc de données, produisant ainsi de nouveaux contenus qui mettent en danger les informations sensibles. Cette évolution exige une approche intentionnelle et prudente de la gouvernance des données.

Comprendre votre patrimoine de données

Avant de mettre en œuvre l'IA, les équipes juridiques doivent examiner attentivement l'ensemble de leur paysage de données. Cela implique de savoir où les données sont stockées, de connaître les autorisations d'accès et de savoir quel type d'informations votre organisation considère comme « sensibles ». L'identification des critères relatifs aux informations sensibles est une première étape essentielle pour limiter les autorisations d'accès sans compromettre la sécurité des données.

Cette phase de découverte constitue la base de la mise en œuvre de l'IA. Il ne s'agit pas seulement de se conformer aux lois sur la protection de la vie privée, mais aussi de comprendre quelles données doivent être conservées pour des raisons réglementaires, quelles données peuvent être supprimées de manière justifiable et dans quelle mesure les autorisations des utilisateurs doivent être modifiées.

La qualité des données de votre organisation joue un rôle important dans l'obtention de résultats efficaces. La réalité de l'utilisation de l'IA pour améliorer les flux de travail et la productivité est que vos résultats seront différents si la qualité des données est insuffisante. De nombreuses organisations passent des années à accumuler des données, et l'essor de l'IA les oblige à procéder à une évaluation longtemps reportée de la qualité et de la conservation des données.

Classification et protection

Toutes les données ne sont pas égales, et vos contrôles de sécurité doivent en tenir compte. Les contenus hautement sensibles doivent être chiffrés, suivis et surveillés. Les données moins sensibles peuvent nécessiter des contrôles moins stricts, mais doivent tout de même être surveillées.

C'est là qu'interviennent les experts en IA responsables et les outils tels que Microsoft Purview. En appliquant des classificateurs entraînables et des étiquettes de sensibilité, les organisations peuvent automatiser l'identification et la protection des données critiques. Les outils de prévention des pertes de données (DLP) en temps réel et de gestion des risques internes agissent ensuite sur ces classifications pour bloquer les actions risquées, avertir les utilisateurs ou déclencher des alertes.

Éduquer et responsabiliser

Même les meilleurs contrôles techniques ne peuvent empêcher toutes les erreurs. La formation et la sensibilisation des utilisateurs sont essentielles pour garantir une conformité globale. De nombreux professionnels ne sont pas formés pour tirer pleinement parti de l'ingénierie des invites ou des nuances du déploiement de l'IA. Les résultats d'une invite bien conçue et spécifique d'un utilisateur varieront considérablement de ceux d'un nouvel utilisateur qui formule une invite vague à l'IA.

La formation des utilisateurs doit se concentrer à la fois sur le « comment » et le « pourquoi ». Apprenez aux utilisateurs à rédiger des invites efficaces, mais aidez-les également à comprendre les implications des autorisations de contenu de l'IA. Formez séparément les différentes équipes fonctionnelles à l'aide de cas d'utilisation qui s'appliquent directement à leur travail. Enfin, rappelez aux utilisateurs que l'IA n'est pas un moteur de recherche, mais un collaborateur qui nécessite des instructions claires et une supervision critique.

Mettre en place un cadre résilient

Les organisations doivent accepter qu'aucun cadre responsable en matière d'IA ne peut être parfait. Tout partage de contenu, quel qu'en soit le degré, peut entraîner des risques, tels que l'exposition involontaire de données sensibles et le dysfonctionnement des invites et des réponses de l'IA. Le partage d'informations trop nombreuses peut entraver les efforts de mise en œuvre et augmenter le risque d'erreurs liées à un accès trop large aux données ou à la gestion des invites. À l'inverse, des schémas de partage trop restrictifs paralyseront la collaboration.

Un cadre responsable en matière d'IA reconnaît cela et trouve le juste équilibre en fonction de la propension au risque acceptée par l'organisation. Afin de permettre la collaboration tout en atténuant les risques inhérents associés, les organisations doivent mettre en œuvre des procédures systématiques pour lutter contre la surexposition des données, surveiller en permanence les interactions de l'IA, contrôler les résultats et améliorer les contrôles d'accès. Il est fortement recommandé d'utiliser un modèle d'accès « le moins permissif possible », dans lequel les utilisateurs n'ont accès qu'aux informations pertinentes pour leurs responsabilités.

Adoption responsable de l'IA

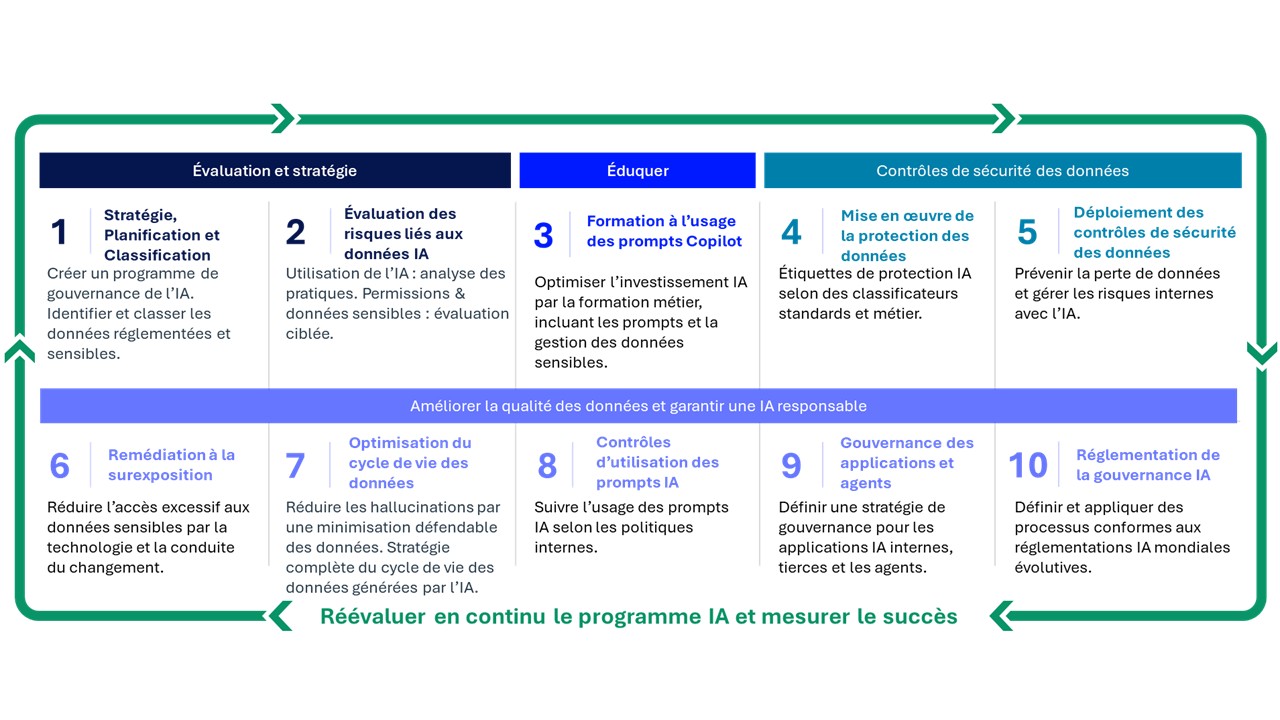

Il y a dix-huit mois, Epiq a lancé son offre « Responsible AI and Copilot Readiness » (IA responsable et préparation au copilotage) avec pour objectif de permettre aux organisations d'exploiter tout le potentiel de l'IA tout en respectant les normes les plus strictes en matière de sécurité et de conformité des données. L'offre comprend dix étapes, commençant par une évaluation, passant rapidement au copilotage dès la troisième étape et assurant une protection à long terme contre la surexposition des données grâce aux étapes quatre à dix.

Depuis lors, les équipes juridiques ont constaté un regain d'intérêt pour les outils d'IA qui stimulent la productivité globale des organisations, améliorent la précision et ouvrent de nouvelles méthodes de travail. Alors que les organisations se précipitent pour adopter ces technologies, une vérité est devenue évidente : sans une stratégie clairement définie en matière de sécurité des données, les risques l'emportent sur les avantages.

Conclusion

L'IA a le potentiel de transformer le travail, mais seulement si elle est mise en œuvre avec soin et intentionnellement. En investissant dans la découverte des données, la classification, la formation des utilisateurs et la protection proactive, les organisations peuvent tirer parti des avantages de l'IA sans compromettre la sécurité ou la conformité.

Ne manquez pas le premier article de cette série de blogs : Stratégie, planification et classification.

Jon Kessler, vice-président et directeur général, Gouvernance de l'information, Epiq

Jon Kessler est vice-président et directeur général de la gouvernance de l'information au sein de la division Legal Solutions chez Epiq, où il dirige une équipe internationale chargée d'aider les clients à exploiter pleinement le potentiel de Microsoft Purview grâce à des services d'IA responsable et de préparation à Copilot. Son équipe fournit des conseils dans un large éventail de domaines liés à la gouvernance et à la conformité, notamment Microsoft Copilot, la confidentialité des données, les risques internes, la conservation légale, la gestion des archives et les processus de données liés aux fusions-acquisitions. Sous sa direction, l'équipe a été reconnue comme partenaire Microsoft de l'année en matière de conformité, finaliste en 2022 et 2024, et lauréate en 2023.

Depuis qu'il a pris ses fonctions de vice-président et directeur général, Jon a doublé la taille et le chiffre d'affaires de l'activité de gouvernance de l'information tout en renforçant l'alignement avec l'écosystème de conformité de Microsoft. Fort d'une expérience dans le domaine de la criminalistique numérique et de l'eDiscovery, il a mené plus de 600 enquêtes judiciaires, a été témoin expert devant des tribunaux fédéraux et d'État, et forme régulièrement des agences gouvernementales et des entreprises du Fortune 500 à l'IA, à la conformité et aux technologies juridiques.

Cet article est destiné à fournir des informations générales et non des conseils ou des avis juridiques.