Angle

責任あるAI導入のためのデータ基盤

- Information governance

- 3 mins

AIが企業のワークフローに組み込まれるにつれ、法務およびコンプライアンスのリーダーは、リスクを管理するだけでなく、Copilot for Microsoft 365のような全社的なツールを含め、責任を持ってAIを採用するために必要な構造、管理、説明責任に関するデータ戦略を策定するという、新たな役割に足を踏み入れている。

このシリーズでは、法務およびコンプライアンスチームが、責任あるAIへの対応に向けてどのようにリードできるかを探ります。

約束と落とし穴

AIは、マーケティング戦略の立案、財務予算の提案、競合分析、顧客サービス事例の要約など、ナレッジワーカーのタスクを効率化する強力な新ツールを提供する。しかし、AIをこれほど魅力的なものにしている同じ機能は、機密データを過剰に露出させるリスクもはらんでいる。

AIが広く採用される以前は、データの保存方法やアクセス方法は企業や機能によってさえも異なっていた。ユーザーやリーダーでさえ、どのような機密情報に誰がアクセスできるかを限定的にしか理解していないことが多く、機密文書を安全に保管するためには、より多くの従業員の認識不足に頼らざるを得ませんでした。現在、Microsoft Copilotのようなツールは、ユーザーが閲覧権限を持つあらゆるデータにアクセスし、表示することができる。そのため、広く共有されるはずのない機密コンテンツ(ビジネス戦略文書、特権的なコミュニケーション、個人を特定できる情報(PII)など)が、不注意によって公開される可能性があります。

歴史的に、アクセス・コントロールは手動ワークフローのために設計されてきた。ユーザーは何千ものファイルにアクセスできるかもしれないが、検索プロンプトやダイレクトナビゲーションがなければ、そのほとんどに出会うことはないだろう。 AIはそれを変える。AIは、データ資産全体から情報を合成して表面化し、機密情報を危険にさらす新たなコンテンツを生み出す。このシフトは、データガバナンスに対する意図的かつ慎重なアプローチを要求する。

データ資産を理解する

AIを実現する前に、法務チームは自社のデータ環境全体をしっかりと把握する必要がある。これには、データの保存場所、アクセス権限の認識、組織が「機密情報」と認定する情報の種類に関する知識が含まれる。機密情報の基準を特定することは、データの脆弱性を残したままアクセス許可を制限するための重要な第一歩です。

この発見段階がAI導入の基礎となる。個人情報保護法の遵守に関することだけでなく、規制上の理由から保持しなければならないデータ、防御的に削除すべきデータ、ユーザー権限をどの程度厳密に変更すべきかを理解することも重要です。

組織のデータの質は、効果的な結果を生み出す上で重要な役割を果たします。AIを活用してワークフローと生産性を向上させるということは、データの質が低いと結果が違って見えるということだ。多くの組織は何年もかけてデータを溜め込んでいるが、AIの台頭により、データの品質と保持について長年の懸案であった評価を迫られている。

分類と保護

すべてのデータが同じように作成されるわけではありません。機密性の高いコンテンツは暗号化し、追跡し、監視する必要があります。機密性の低いデータは、より軽い管理で済むかもしれませんが、それでも監視する必要があります。

そこで、責任あるAIの専門家とMicrosoft Purviewのようなツールが活躍します。学習可能な分類器と機密ラベルを適用することで、組織は重要データの識別と保護を自動化できる。リアルタイムのデータ損失防止(DLP)とインサイダーリスク管理ツールは、これらの分類に基づいて動作し、危険なアクションをブロックしたり、ユーザーに警告を発したり、アラートをトリガーしたりする。

教育と権限付与

どんなに優れた技術的管理でも、すべてのミスを防ぐことはできません。全体的なコンプライアンスを確保するためには、ユーザーの教育とトレーニングが不可欠である。多くの専門家は、プロンプトエンジニアリングやAI導入のニュアンスを適切に活用する訓練を受けていません。あるユーザーがよく練られた具体的なプロンプトを出した場合と、新人ユーザーが漠然とAIにプロンプトを出した場合とでは、その結果は大きく異なるだろう。

ユーザートレーニングは、「方法 」と 「理由 」の両方に焦点を当てるべきである。効果的なプロンプトの書き方を教えるだけでなく、AIのコンテンツ権限の意味も理解させる。異なる機能チームには、それぞれの業務に直接適用されるユースケースを使って個別にトレーニングを行う。最後に、AIは検索エンジンではなく、明確な指示と重要な監視を必要とする協力者であることをユーザーに思い出させる。

レジリエントなフレームワークの構築

組織は、責任あるAIのフレームワークが完璧であるはずがないことを受け入れなければならない。どの程度のコンテンツ共有であっても、機密データの意図しない暴露や、AIのプロンプトやレスポンスが意図したとおりに機能しないといったリスクが生じる可能性がある。あまりに多くの情報を共有しすぎると、実施努力が妨げられ、広範なデータ・アクセスやプロンプト管理に関連するエラーの可能性が高まる。一方、過度に制限的な共有スキーマは、コラボレーションを停滞させる。

責任あるAIのフレームワークは、このことを認識し、組織が許容するリスク選好度に基づいて適切なバランスをとる。コラボレーションを可能にすると同時に、内在する関連リスクを軽減するために、組織はデータの過剰露出に対処する体系的な手順を導入し、AIの相互作用を継続的に監視し、出力を監査し、アクセス制御を改善する必要がある。ユーザーが自分の責任に関連する情報のみにアクセスできる「最小許容」アクセスモデルの活用が強く推奨される。

責任あるAIの採用

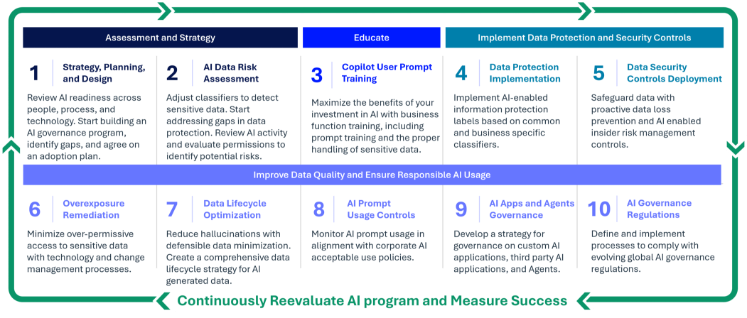

18カ月前、Epiqは、最高水準のデータセキュリティとコンプライアンスを維持しながら、組織がAIの可能性を最大限に活用できるようにするというビジョンを掲げ、Responsible AI and Copilot Readinessの提供を開始した。このサービスには10のステップがあり、アセスメントから始まり、ステップ3によってコパイロットを迅速にユーザーの手に渡し、ステップ4から10によってデータの過剰露出から長期的に保護する。

それ以来、法務部門では、組織全体の生産性向上、精度の向上、新たな働き方の実現を可能にするAIツールへの関心が急増している。組織がこれらの技術の導入を急ぐ中、一つの真実が明らかになった。明確に定義されたデータセキュリティ戦略がなければ、リスクが利益を上回るということだ。

要点

AIは業務を変革する可能性を秘めているが、それは慎重かつ意図的に導入された場合に限られる。データ発見、分類、ユーザー教育、そして積極的な保護への投資を通じて、組織はセキュリティやコンプライアンスを損なうことなくAIの恩恵を享受できる。

このブログシリーズの第一弾「戦略、計画、分類」にご期待ください。

ジョン・ケスラー、Epiq 情報ガバナンス担当副社長兼ゼネラルマネージャー

ジョン・ケスラーは、Epiqのリーガルソリューション部門において情報ガバナンス担当副社長兼ゼネラルマネージャーを務め、責任あるAIおよびコパイロット対応サービスを通じてクライアントがMicrosoft Purviewの価値を解き放つことを支援するグローバルチームを率いています。彼のチームは、Microsoft Copilot、データプライバシー、内部者リスク、リーガルホールド、記録管理、M&Aデータプロセスなど、幅広いガバナンスおよびコンプライアンス分野について助言を提供しています。彼のリーダーシップのもと、チームはマイクロソフト コンプライアンス パートナー オブ ザ イヤーにおいて、2022年と2024年にファイナリスト、2023年に受賞者として認められました。

副社長兼ゼネラルマネージャー就任後、ジョンは情報ガバナンス事業の規模と収益を倍増させると同時に、マイクロソフトのコンプライアンス・エコシステムとの連携を強化しました。デジタルフォレンジックとeディスカバリー分野での経歴を持ち、600件以上のフォレンジック調査を主導し、連邦裁判所および州裁判所で専門家証人として証言。政府機関やフォーチュン500企業に対し、AI、コンプライアンス、リーガルテクノロジーに関するトレーニングを定期的に実施しています。